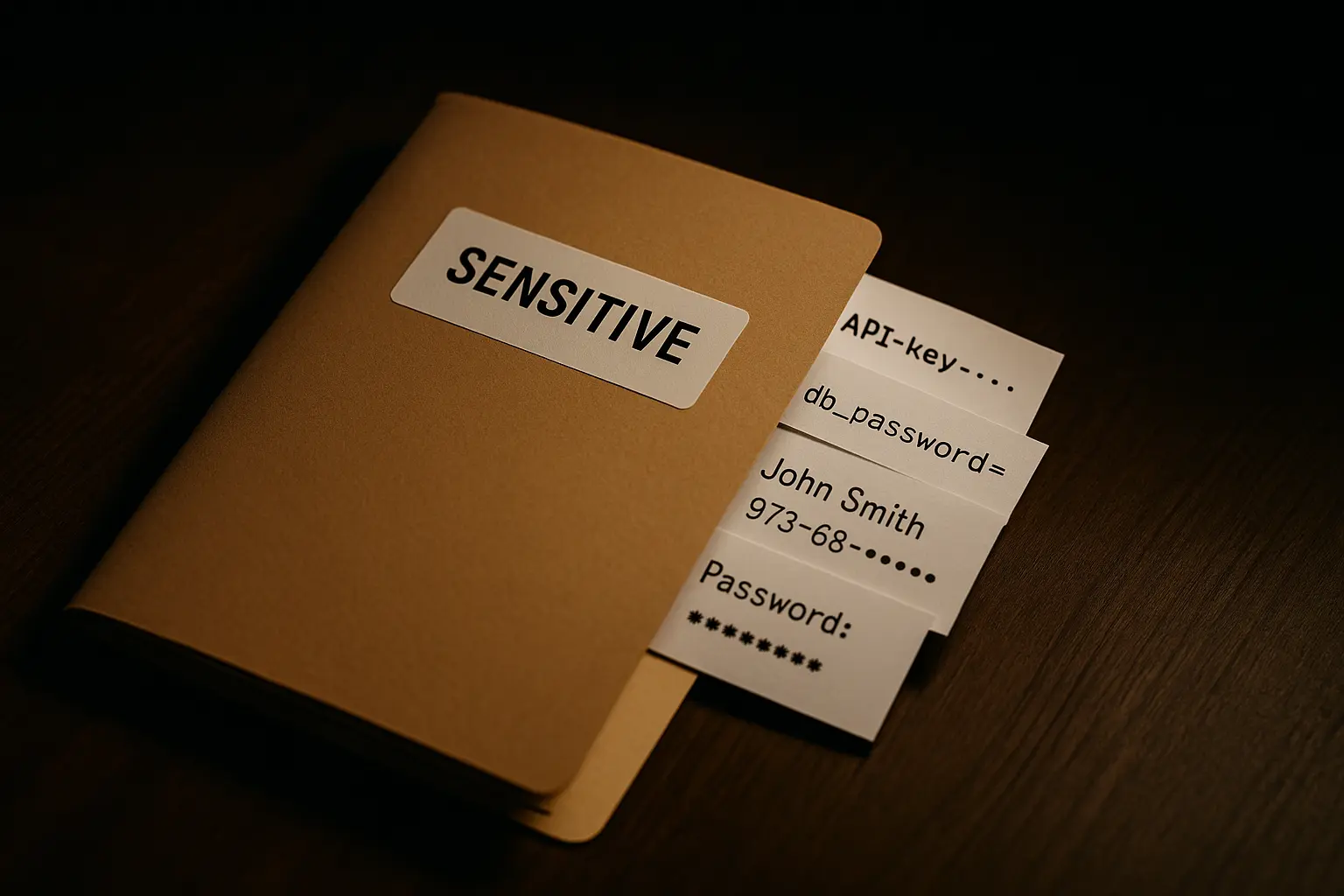

Tag: Indirect Prompt Injection Attack

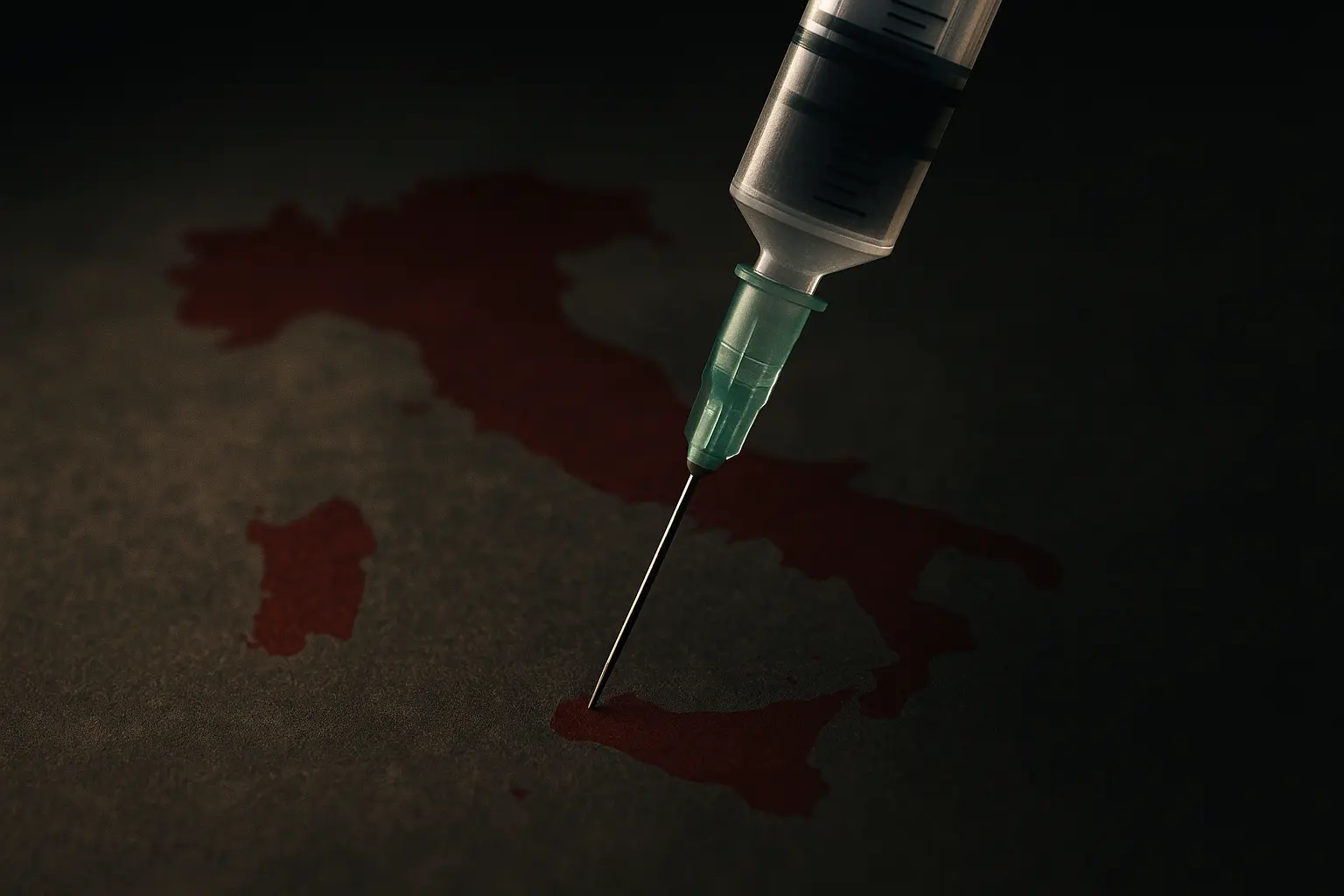

Tecnica di attacco contro sistemi basati su Large Language Model (LLM) in cui istruzioni malevole vengono iniettate indirettamente tramite contenuti esterni processati dal modello, come documenti, email, pagine web o database. A differenza del prompt injection diretto, l’attaccante non controlla il prompt iniziale ma manipola dati di input che il sistema LLM recupera e interpreta, causando comportamenti non autorizzati, esfiltrazione di informazioni o bypass di policy di sicurezza.