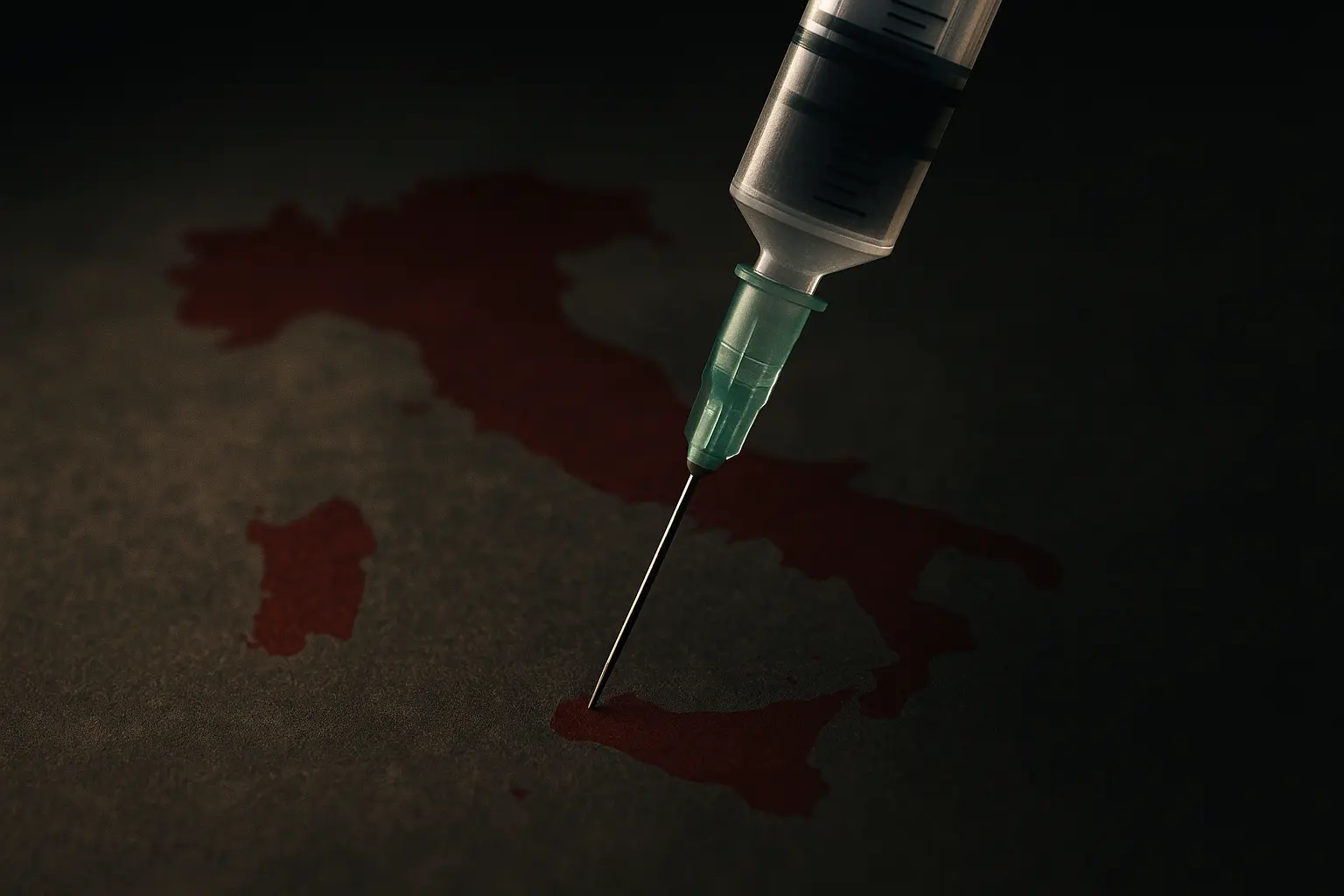

Tag: Testing for Toxic Output

Verifica della capacità di sistemi AI e LLM di generare contenuti tossici, offensivi, discriminatori o eticamente problematici. Include test per bias, hate speech, misinformation, contenuti violenti o inappropriati, e tecniche di jailbreaking che aggirano i filtri di sicurezza per indurre il modello a produrre output dannosi o non conformi alle policy di utilizzo.